Dans un récent sondage, les Français témoignent de leur difficulté à identifier les deepfakes et se disent favorables à une signalisation claire des contenus concernés.

Avec les progrès de l’intelligence artificielle, le monde est quotidiennement confronté aux deepfakes. Si de nombreuses personnalités publiques sont régulièrement visées, les anonymes ne sont pas à l’abri. Les Français ont-ils connaissance de ce phénomène ? Se sentent-ils capables d’y faire face ? Ont-ils des craintes ? L’IFOP les a interrogés.

Incapacité à distinguer le vrai du faux

Seul un tiers (33 %) des Français se sent en capacité de détecter une image ou une vidéo générée par IA (6 % en sont sûrs). Les jeunes, plus à l'aise avec les nouvelles technologies, sont ceux qui s'estiment le plus à même de repérer un deepfake (55 % des 18-24 ans). Dans le détail, les hommes s'estiment à 40 % capables de repérer de telles images contre 28 % chez les femmes. Conscient de leur vulnérabilité et des risques, l’écrasante majorité (90 %) des Français sont favorables à la mise en place d’une mention permettant d’identifier les deepfakes. Une attente plus forte chez les plus de 35 ans qui y sont favorables à 93 % contre 79 % chez les 18-24 ans.

Leurs craintes sont-elles fondées ?

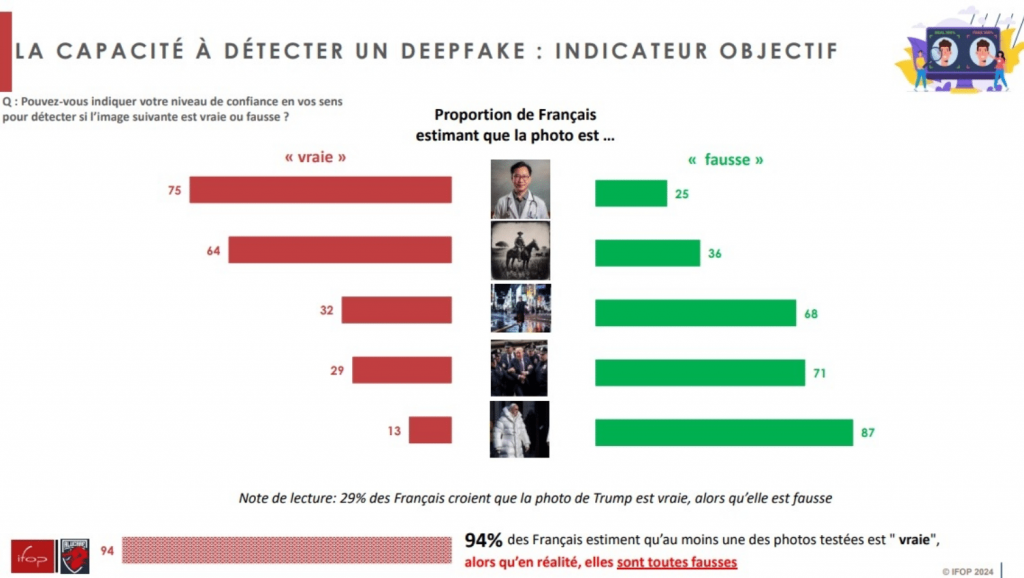

Invités à examiner cinq images, 94 % des répondants ont cru à la véracité d’au moins un des clichés. En réalité, toutes les images présentées étaient « fausses ».

Des détails qui permettent de repérer les deepfakes

Pour 59 % des répondants, le mouvement des lèvres jugés « pas assez naturel » est un indice qui leur semble assez simple à repérer. De même, le fait que les individus représentés ne clignent pas assez souvent des yeux serait un bon indicateur pour un tiers (33 %) d'entre eux. Dans une proportion similaire, 32 % pointent les difficultés, avérées (mais de moins en moins d’actualité), des IA génératives à reproduire correctement les mains. Une peau ridée ou trop plate (29 %), des lunettes qui ne reflètent pas correctement la lumière (25 %), des ombres autour des yeux imprécises (21 %) ou encore un manque de pilosité à certains endroits du visage (15 %) sont autant d’imperfections considérées comme de potentiels signaux d’alerte. Néanmoins, seule une minorité des répondants les juge aisés à débusquer.

Un manque de connaissance

Face à ce phénomène grandissant, près de 7 Français sur 10 indiquent avoir déjà entendu parler de deepfakes, mais seulement 30 % savent précisément de quoi il s’agit. À nouveau, les jeunes générations semblent les mieux informées : 83 % des 18-24 ans (contre 66 % des plus de 35 ans) en ont connaissance et 50 % (contre 15 % des plus de 65 ans) en ont une vision nette.

Un tiers des Français ont déjà diffusé des fake news

Deepfakes et fake news nourrissent la désinformation. Une manipulation à laquelle une partie des Français reconnaît participer, y compris à son insu. Ainsi, 31 % des personnes interrogées (soit 7 points de plus que dans une étude BVA de 2019) reconnaissent avoir déjà relayé auprès de leur entourage des informations qui se sont ensuite révélées fausses (46 % chez les jeunes contre 25 % chez les plus de 50 ans).

Une acceptation morale parfois douteuse

Parmi les différentes utilisations de l’IA qui leur ont été présentées dans cette enquête (image, vidéo ou encore clonage de voix) aucune n’est jugée moralement acceptable par la majorité des personnes interrogées. La création de contenus « artistiques » par une IA (42 % estiment cela moralement acceptable) et la retouche de photos sur les réseaux sociaux à l’aide de filtres (32 %) sont les deux usages les mieux acceptés. Plus étonnant – où inquiétant ? – 30 % sont favorables à l'idée que l’IA serve à surveiller des « actes de rébellion ou de dissidence de citoyens. » Les moins de 35 ans sont 34 % à trouver cette pratique acceptable, contre 29 % chez les plus de 35 ans. En interrogeant sur l'usage de ces nouvelles technologies pour « s’amuser » comme déshabiller des personnes grâce à l’IA, l'enquête révèle d’importantes différences générationnelles et de genres. Si seuls 9 % reconnaissent ne pas être choqués par une telle utilisation, le chiffre monte à 17 % chez les moins de 35 ans (jusqu’à 26 % chez les hommes de cette tranche d'âge) contre 6 % chez leurs aînés. Les hommes sont 13 % à juger moralement acceptable cette pratique contre 4 % des femmes.

Un risque pour la démocratie ?

S’ils craignent pour eux-mêmes, plus de 6 Français sur 10 se disent inquiets que des deepfakes puissent perturber les prochaines élections présidentielles (16 % assurent en avoir très peur). Plus soucieux que la moyenne lorsqu’il s’agit du détournement de leur propre image, les jeunes le semblent beaucoup moins : 49 % des moins de 25 ans en ont peur alors que 70 % des plus de 65 ans le redoutent.

Enfin, face à la généralisation des outils, 57 % des répondants expriment la crainte d’en être victimes. Si les plus jeunes sont les plus inquiets (64 % chez les 18-24 ans), 56 % des plus de 25 ans le redoutent également. Dans les faits, 4 % d’entre eux et 13 % des moins de 25 ans révèlent en avoir déjà été victimes.

Méthodologie : Enquête IFOP pour Alucare.fr réalisée par questionnaire auto-administré du 5 au 8 mars 2024 auprès de 2191 personnes représentatives de la population française de 18 ans et plus, dont 551 jeunes de moins de 35 ans.

Les données IA, sont issues de la "poubelle" Internet dont nous sommes tous, les producteurs. Les deepfakes s'y cueillent à loisirs. On est d'accord ou pas ? L'IA a trouvé les moyens et donc les ressources pour les organiser en langage cohérent, via des logiciels idoines.

Sur le logiciel Word, il existait une fonction primaire pour faire des "synthèses" (de la plus concise à la moins concise, 5% à 50% si ma mémoire est bonne). Toujours sur ce logiciel existait (car je ne le retrouve plus dans les versions à partir de 2007) un outil qui vous permettait de mettre en 'brillance' (ou mode guirlande, vibration, les anciennes secrétaires - pas de sexisme de ma part). Je l'ai utilisée pour envoyer des textes canulars à mes correspondants qui croyaient le temps de la lecture, qu'ils avaient un problème de vue -;). Tout ça pour dire qu'une application est possible pour flouter les deepfakes ou les mettre en surbrillance. Maintenant il faut trouver les développeurs. Ce n'est pas mon cas hélas !