Plutôt que d'exposer frontalement des idées racistes ou antisémites, des utilisateurs TikTok disséminent ces dernières en utilisant des images générées par intelligence artificielle.

« C’est moi qui ai tué le petit Thomas parce qu’il était blanc ». Sur TikTok, le compte cauchemars.obscurs a publié quelques jours après le drame de Crépol une étrange vidéo témoignage. On y voit une image animée générée par intelligence artificielle parler à la place de l'un des accusés du meurtre. À la première personne, il explique comment lui et sa bande ont « voulu s’incruster dans la soirée de Thomas », et sont revenus « tenter de tuer tout ce qui bougeait » après avoir été recalés par le videur. Le tout est raconté avec une musique triste et des photos prises pendant le drame.

La vidéo qui a fait plus de 180 000 vues n’est pas la seule à avoir été postée sur ce compte. Toujours dans le style généré par Midjourney, on trouve une vidéo détaillant le casier judiciaire d’un des accusé, une autre brossant un portrait larmoyant de la victime du coup de couteau. Plus largement le compte cauchemars.obscurs publie beaucoup de contenus liés à des faits divers ou des histoires horrifiques. Ce nouveau format, facile à produire, vise moins à informer qu'à provoquer des vues en surfant sur des histoires sordides. Est-ce que ce compte se revendique d’une idéologie raciste ? Difficile de l'affirmer. Il semble surtout reprendre, des éléments de langage et de la désinformation martelés au moment de la tragédie de Crépol.

Marine Le Pen à la sauce Pixar

Cette facilité à produire de la désinformation de manière esthétique et faire passer certaines idées n’a pas échappé aux militants les plus extrêmes. C’est le cas avec le compte etsi.story qui semble spécialisé dans la mise en scène de « scénarios alternatifs » et présente les politiques comme des personnages de dessin animé Pixar. On y retrouve une Marine Le Pen au look de princesse Disney qui dit au revoir à des Arabes parqués dans un bateau (représentés par des Saoudiens souriants). La présidente du RN est aussi représentée en train d'embrasser un sanglier, ou de tendre une bouteille de vin à un musulman avec le mot assimilation écrit en gros. Dans une autre vidéo, on trouve un Jean-Luc Mélenchon grimé en émir du Qatar ou un Éric Zemmour souriant qui renvoie lui aussi des Arabes dans un avion.

Dans les commentaires, les internautes se payent une bonne tranche de rigolade. « C’est bien fait comme affiche », « enfin de bons films Disney en vue », « hâte qu’il sorte », etc. Ces petites phrases confirment que ce contenu respecte à la lettre la loi de Poe. Cette règle implicite stipule que sur Internet il est impossible, sans une indication claire de l’auteur, de distinguer un point de vue extrémiste ou outrancier de sa parodie. Les personnes acquises à l’extrême droite savent parfaitement reconnaître une vidéo qui leur est adressée tandis que les utilisateurs lambda vont trouver les images amusantes sans forcément s’apercevoir qu’elles normalisent des idées racistes.

Des chats avec une kippa

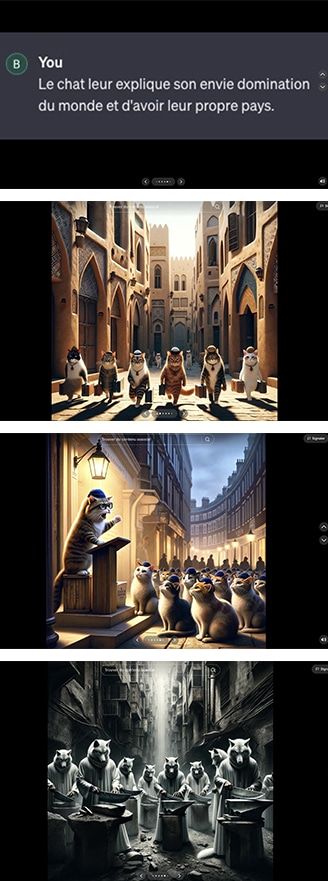

Ces outils ne sont pas seulement utilisés par l’extrême droite. Le compte Imagine.corp, qui produit lui aussi de nombreuses vidéos générées par IA, a réinventé une histoire très falsifiée et pleine de clichés antissémites de la création de l’État d’Israël. Les juifs sont représentés par des chats portant la kippa et complotant dans la nuit pour « dominer le monde et avoir son propre pays ». Ils finissent par être aidés par des lions (sans doute les Britanniques) qui vont les installer sur le territoire des loups, comprenez ici les Palestiniens. La deuxième vidéo s’achève sur une image de loup en train d’aiguiser des couteaux pour récupérer leur territoire, une manière de justifier l’attaque qui a eu lieu le 7 octobre dernier. Dans les commentaires, on trouve des réactions qui osciellent entre confusion ( « c’est qui les lions » ) et approbation complotiste ( « ils gouvernent déjà ton pays jusqu’à la racine » ).

À la différence des images ultraréalistes qui ont pu être utilisées dans les conflits en Ukraine et en Palestine, cette forme de communication est autrement plus pernicieuse. Elle s’appuie sur une esthétique cartoon et mignonne ainsi que sur les derniers formats de storytelling émergeant sur TikTok. Parmi eux : la succession d’images générées par IA pour donner un aspect « inoffensif » à des idées pourtant très toxiques. De quoi attraper les jeunes utilisateurs qui croient s’informer librement en utilisant la barre de recherche de l’application. Dans ce no man’s land de l’information, la propagande y prend alors des atours séduisants.

Participer à la conversation